안녕하세요. KDST팀 김현수 입니다.

제가 이번에 소개드릴 논문은 최근 3D Reconstruction, 3D Rendering 분야에서 NeRF를 제치고, 메인 아키텍쳐로 자리잡은 3D Gaussian Splatting 입니다.

arxiv : https://arxiv.org/abs/2308.04079

github : https://github.com/graphdeco-inria/gaussian-splatting

기존에 3D reconstruction 분야에서는 NeRF, Mip-NeRF, Mip-NeRF 360 등 NeRF 기반의 방법론들이 많이 연구되어 왔습니다. 그러나 NeRF의 가장 큰 단점은 시간이 오래 걸린다는 것이고, 이는 real-time rendering 등을 수행하기에 적합하지 않습니다.

InstructNGP 등은 inference 시간이 별로 안 걸리지만, Mip-NeRF 등에 비해서 고해상도의 reconstruction을 할 수 없다는 단점이 있습니다.

본 논문에서는 3D Gaussian을 활용해 high quality real-time rendering을 가능하게 하는 방법론을 제안하고 있습니다.

우선 3D gaussian이란 무엇일까요?

아래 그림은 고등학교때 배운 정규분포(1D Gaussian)와 이를 2차원으로 표현한 2D Gaussian의 형태입니다.

3D Gaussian도 이와 유사하게, 한 차원만 추가해주면 됩니다. 이는 구 형태로 생겼는데, 우측 그림의 3D Gaussian Visualization을 자세히 보면, 숲이 여러개의 초록색 구 형태가 합쳐져서 구성되어 있음을 알 수 있습니다.

위에서 설명했듯, 본 논문에서는 이러한 3D Gaussian 즉, 구 형태를 최적화하여 3D scene을 표현할 수 있도록 학습합니다.

아래 그림은 3D Gaussian이 학습되는 flow입니다.

입력으로 들어 오는 것은 한 object를 여러 각도에서 찍은 image들 입니다. 이를 SfM 알고리즘을 이용하여 SfM points들을 찾아내어 Gaussian들의 initialization parmeter로 활용합니다.

SfM 알고리즘이란 Photo Tourism: Exploring Photo Collections in 3D 논문에서 제안한 알고리즘으로, 하나의 대상을 촬영한 여러장의 입력 이미지로부터, 이 대상의 representation을 잘 나타낼 수 있는 point cloud들을 찾아내는 알고리즘입니다.

Gaussian Splatting에서는 이렇게 찾은 point들을 Gaussian의 초깃값으로 사용합니다.

조금 더 구체적으로는 이를 Gaussian의 평균값(M)으로 초기화하는데, 이 외에도 S(covariance), C(color), A(opacity) 등을 초기화해줍니다.

이렇게 Gaussian을 초기화해줬으면, input으로 받은 각 이미지들에서의 각도와 함께 이를 projection 시켜주고, 이를 미분가능한 Tile Rasterizer를 활용해 loss를 계산할 수 있는 이미지 I 형태로 만들어줍니다.

알고리즘으로 보면 아래와 같습니다.

이렇게 구한 이미지 I와 우리가 원래 알고있던 ground truth I hat을 이용해 loss를 계산해줍니다. 이때, loss function으로는 L1 loss와 SSIM loss를 함께 사용합니다.

loss를 계산한 뒤 rasterizer가 미분 가능하기 때문에 역전파를 통해 gaussian들의 각 파라미터(M,S,C,A)를 업데이트 해줍니다.

이때 Adaptive Density Control이란 알고리즘이 작용하는데, Gaussian의 크기가 너무 크거나 작으면 이를 복제 / 분할 하여 표현하고자 하는 representation을 잘 담을 수 있게 만들어주는 것입니다.

Gaussian의 공분산이 너무 크면 이를 Split해주고, 너무 작으면 이를 Clone하여줍니다.

전체적인 프로세스를 알고리즘과 함께 보면 아래 그림과 같습니다.

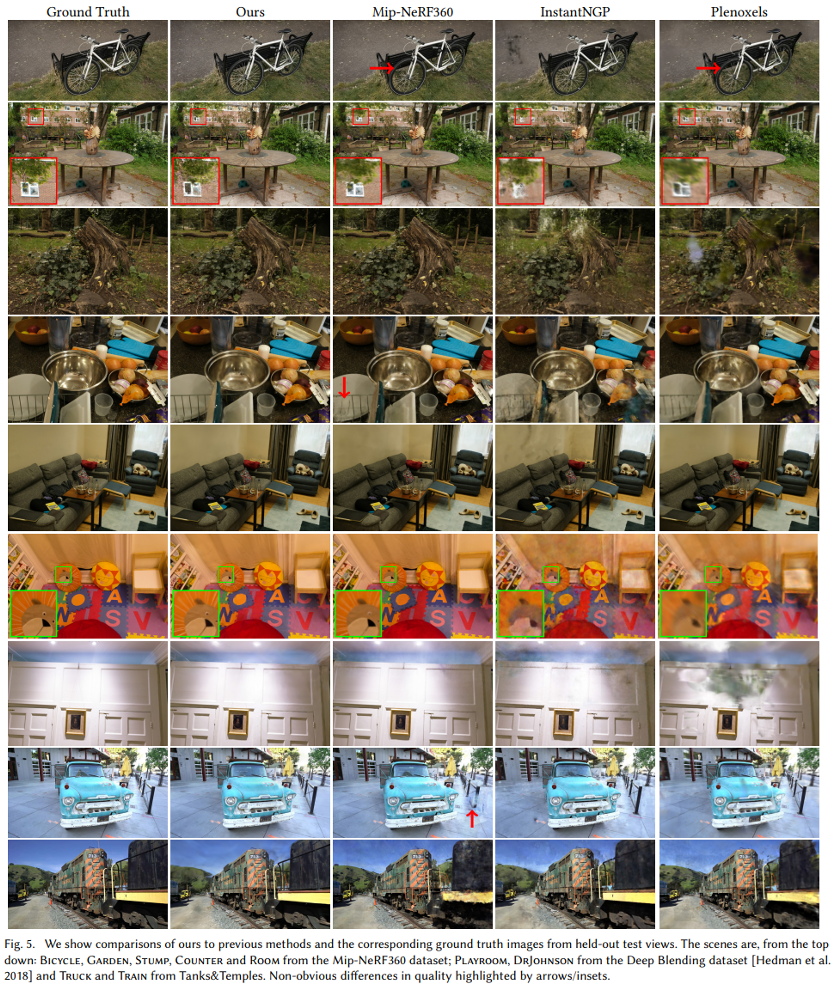

실험 결과는 정말 놀라운데, 이전에 가장 속도가 빨랐던 InstructNGP는 물론, SOTA 모델이였던 Mip-NeRF 360 보다도 훨씬 좋은 3D reconstruction 성능을 보여주고 있습니다. 특히 디테일한 부분도 3DGS는 굉장히 잘 잡는 것을 볼 수 있습니다.

정량 지표 역시 다른 기존의 모델들 보다 훨씬 좋음을 보여주고 있습니다.

더 많은 실험 결과 및 real time rendering 결과(video)는 공식 프로젝트 사이트 혹은 논문을 참고하시기 바랍니다.

읽어주셔서 감사합니다.